多线程技术如何提升服务器的并发处理能力

一、引言

随着互联网技术的飞速发展,服务器所面临的并发请求压力日益增大。

为了提高服务器的处理能力和响应速度,多线程技术成为了关键的技术手段之一。

本文将详细探讨多线程技术如何提升服务器的并发处理能力。

二、多线程技术概述

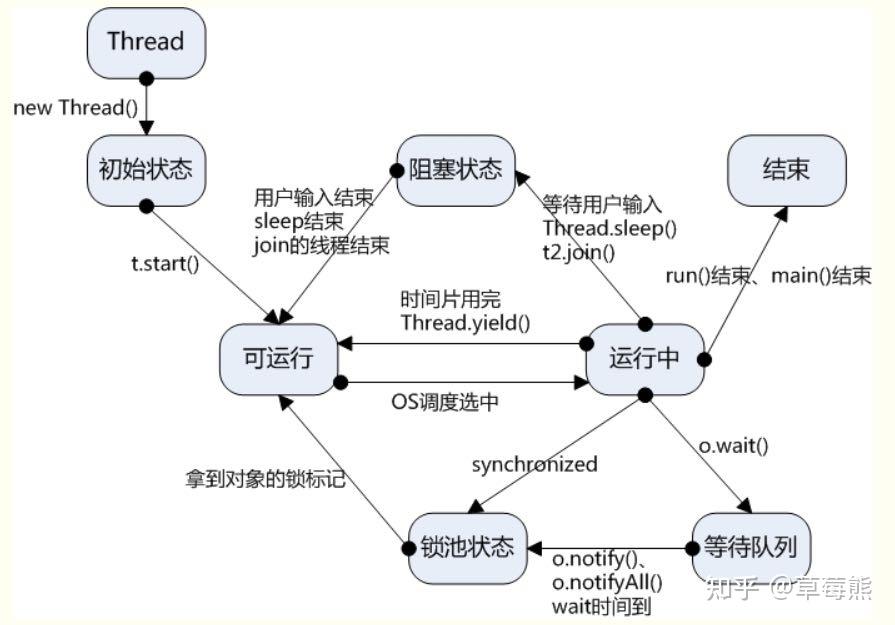

多线程技术是一种使程序能够同时执行多个任务的技术。

在多线程环境下,一个程序可以同时拥有多个线程,每个线程可以独立执行不同的任务。

多线程技术可以有效地利用CPU资源,提高系统的并发处理能力。

三、多线程技术在服务器中的应用

1. 并发处理:服务器在处理大量并发请求时,通过多线程技术可以同时处理多个请求,避免了传统单线程模型中的请求阻塞问题,提高了服务器的响应速度和吞吐量。

2. 任务分配:多线程技术可以根据系统的实际情况,动态地分配任务给不同的线程,实现任务的并行处理,从而提高服务器的处理效率。

3. 资源管理:通过多线程技术,服务器可以更好地管理资源,如内存、CPU等,实现资源的合理分配和有效利用。

四、多线程技术提升服务器并发处理能力的机制

1. 利用CPU资源:多线程技术可以充分利用CPU资源,避免单线程模型下CPU资源的空闲和浪费。当服务器面临大量并发请求时,多个线程可以同时执行,充分利用CPU的计算能力。

2. 减少上下文切换:多线程技术通过合理的任务分配和调度,可以减少系统上下文切换的次数,降低系统的开销,提高系统的运行效率。

3. 异步处理:通过多线程技术,服务器可以实现异步处理,即当一个请求正在处理时,其他请求可以在其他线程中同时进行,提高了服务器的响应速度和并发处理能力。

五、多线程技术的实现与优化

1. 线程池技术:为了降低创建和销毁线程的开销,可以采用线程池技术。线程池维护一定数量的线程,当请求到来时,直接从线程池中获取线程进行处理,避免了频繁创建和销毁线程的操作。

2. 任务调度:合理的任务调度策略可以平衡系统的负载,避免某些线程的过载。可以采用公平调度、优先级调度等策略,根据系统的实际情况进行任务分配。

3. 锁机制:在多线程环境下,需要保证数据的安全性和一致性。可以采用锁机制来避免数据竞争和冲突,如互斥锁、读写锁等。

4. 性能监控与优化:通过监控系统的性能数据,如CPU使用率、内存占用等,可以及时发现系统的瓶颈和问题,进行针对性的优化。

六、案例分析

以某电商网站的服务器为例,该服务器采用多线程技术处理用户的请求。

在面临大量并发请求时,通过多线程技术,服务器可以同时处理多个用户的请求,避免了请求阻塞的问题,提高了服务器的响应速度和吞吐量。

同时,通过合理的任务调度和线程池技术,服务器实现了资源的合理分配和有效利用,提高了服务器的处理效率。

七、结论

多线程技术是提高服务器并发处理能力的重要手段之一。

通过充分利用CPU资源、减少上下文切换、实现异步处理等方式,多线程技术可以有效地提高服务器的响应速度和吞吐量。

同时,通过合理的实现与优化,如线程池技术、任务调度、锁机制等,可以进一步提高服务器的性能。

因此,在实际应用中,应充分利用多线程技术,提高服务器的并发处理能力。

说一说超线程/同步多线程(HT/SMT)技术那些事儿

超线程(HT/SMT)技术,实际上指的是同步多线程(SMT)技术,由Intel包装并推向市场。

这一技术初衷是为了提升CPU核心后端执行单元的利用率,进而提升整体并行性能。

通过将一个物理核心虚拟出多个核心,实现多线程并行执行,以此提升CPU的单核性能。

现在,无论是PC还是服务器CPU,超线程技术已经成为标配。

超线程技术通过提升单核性能来间接提升多线程性能。

在单核单线程任务中,通过指令级并行(ILP)实现任务的并发执行,缩短执行时间。

通过将指令分组并分配到不同的执行端口,实现资源的有效利用,从而提升整体性能。

引入SMT技术,将多个任务并发执行在一个核心内,实现资源的高效利用。

在理想情况下,两个任务的执行时间可以缩短至单个任务执行时间的60%,相较于物理多核心,SMT技术更加经济高效。

然而,SMT技术并非无代价,它引入了如资源竞争、上下文切换等问题。

不同的核心配置(如SMT2、SMT4等)取决于后端资源的空闲程度以及任务间的依赖冲突情况。

在资源利用充分且任务间冲突较少的情况下,SMT技术能有效提升性能;反之,过度配置SMT可能会引入不必要的开销。

对于一般用户,关闭SMT技术可能并不必要。

现代操作系统考虑了SMT特性,合理调度任务,避免了单核性能倒退和资源冲突。

只有在追求极致性能且确信不需要多线程性能的情况下,关闭SMT可能是更优选择。

辨别物理核心与逻辑核心,并无真假之分。

在大多数情况下,逻辑核心与物理核心之间的切换不会对任务执行造成负面影响。

因此,是否关闭SMT技术,应根据具体需求和性能目标来决定。

qt中如何实现多线程?

在Qt中实现多线程,需要对网络编程基本概念有一定的理解。

在网络编程中,服务器端通常会监听一个socket,每当接收到客户端的连接请求,就会生成一个新的socket描述符。

这个描述符用于客户端与服务器间的通信。

如果你选择使用QTcpServer类,可以重写其incomingConnection()函数,此函数会返回一个socket描述符,你可以在函数中使用这个socket描述符来创建一个新的线程,然后在这个新线程中进行socket描述符的通信操作。

这种“通知+多线程”的服务器编程模型在Qt中得到了天然的支持,实现起来相对简单。

在Qt中,通过重写QTcpServer类的incomingConnection()函数,可以轻松地处理客户端连接请求。

在这个函数中,你可以获取到一个新的socket描述符,然后使用这个socket描述符创建一个新的线程。

在新线程中,你可以进行与客户端的通信操作,比如发送和接收数据。

这样,即使有多个客户端同时连接,服务器端也不会因为处理多个连接而变得卡顿。

这种模式不仅能够提高服务器的响应速度,还能保证服务器能够高效地处理多个客户端的请求。

在实际应用中,多线程编程可以显著提升服务器的并发处理能力,特别是在处理大量客户端请求时,这种模式的优势尤为明显。

通过将每个客户端的连接请求分配到不同的线程中处理,可以确保每个客户端都能得到及时的响应,而不会因为一个客户端的长时间处理而影响到其他客户端的服务。

使用Qt进行多线程编程时,你还可以利用QThread类来创建线程,并使用QRunnable接口来定义线程任务。

通过这种方式,你可以更灵活地控制线程的创建和销毁,以及线程任务的执行。

此外,Qt还提供了信号和槽机制,使得线程之间的通信变得简单而高效。

通过这些机制,你可以在主线程和子线程之间安全地传递数据和控制信息,从而构建出一个高效、稳定的网络应用程序。

如何提高服务器并发能力

有什么方法衡量服务器并发处理能力1. 吞吐率吞吐率,单位时间里服务器处理的最大请求数,单位req/s从服务器角度,实际并发用户数的可以理解为服务器当前维护的代表不同用户的文件描述符总数,也就是并发连接数。

服务器一般会限制同时服务的最多用户数,比如apache的MaxClents参数。

这里再深入一下,对于服务器来说,服务器希望支持高吞吐率,对于用户来说,用户只希望等待最少的时间,显然,双方不能满足,所以双方利益的平衡点,就是我们希望的最大并发用户数。

2. 压力测试有一个原理一定要先搞清楚,假如100个用户同时向服务器分别进行10个请求,与1个用户向服务器连续进行1000次请求,对服务器的压力是一样吗?实际上是不一样的,因对每一个用户,连续发送请求实际上是指发送一个请求并接收到响应数据后再发送下一个请求。

这样对于1个用户向服务器连续进行1000次请求, 任何时刻服务器的网卡接收缓冲区中只有1个请求,而对于100个用户同时向服务器分别进行10个请求,服务器的网卡接收缓冲区最多有100个等待处理的请求,显然这时的服务器压力更大。

压力测试前提考虑的条件并发用户数: 指在某一时刻同时向服务器发送请求的用户总数(HttpWatch)总请求数请求资源描述请求等待时间(用户等待时间)用户平均请求的等待时间服务器平均请求处理的时间硬件环境压力测试中关心的时间又细分以下2种:用户平均请求等待时间(这里暂不把数据在网络的传输时间,还有用户PC本地的计算时间计算入内)服务器平均请求处理时间用户平均请求等待时间主要用于衡量服务器在一定并发用户数下,单个用户的服务质量;而服务器平均请求处理时间就是吞吐率的倒数,一般来说,用户平均请求等待时间 = 服务器平均请求处理时间 * 并发用户数怎么提高服务器的并发处理能力1. 提高CPU并发计算能力服务器之所以可以同时处理多个请求,在于操作系统通过多执行流体系设计使得多个任务可以轮流使用系统资源,这些资源包括CPU,内存以及I/O. 这里的I/O主要指磁盘I/O, 和网络I/O。

多进程 & 多线程多执行流的一般实现便是进程,多进程的好处可以对CPU时间的轮流使用,对CPU计算和IO操作重叠利用。

这里的IO主要是指磁盘IO和网络IO,相对CPU而言,它们慢的可怜。

而实际上,大多数进程的时间主要消耗在I/O操作上。

现代计算机的DMA技术可以让CPU不参与I/O操作的全过程,比如进程通过系统调用,使得CPU向网卡或者磁盘等I/O设备发出指令,然后进程被挂起,释放出CPU资源,等待I/O设备完成工作后通过中断来通知进程重新就绪。

对于单任务而言,CPU大部分时间空闲,这时候多进程的作用尤为重要。

多进程不仅能够提高CPU的并发度。

其优越性还体现在独立的内存地址空间和生命周期所带来的稳定性和健壮性,其中一个进程崩溃不会影响到另一个进程。

但是进程也有如下缺点:fork()系统调用开销很大: prefork进程间调度和上下文切换成本: 减少进程数量庞大的内存重复:共享内存IPC编程相对比较麻烦