HTTP请求量与服务器性能的关系

一、引言

随着互联网技术的飞速发展,HTTP请求量逐渐成为衡量服务器性能的重要指标之一。

HTTP请求量指的是服务器在单位时间内接收的客户端发出的HTTP请求数量。

服务器性能则涉及到处理请求的速度、响应时间、并发能力等多个方面。

本文将小哥探讨HTTP请求量与服务器性能之间的关系。

二、HTTP请求量对服务器性能的影响

1. 处理能力考验

随着HTTP请求量的增加,服务器需要处理更多的请求,这对服务器的处理能力提出了更高的要求。

服务器必须能够快速处理每个请求并返回响应,以保证整体性能。

2. 响应时间延长

当HTTP请求量过大时,服务器可能会面临资源瓶颈,导致处理速度降低,响应时间延长。

这可能导致用户体验下降,甚至可能导致用户流失。

3. 并发能力挑战

HTTP请求量的增加也意味着并发请求的增加。

服务器需要具备良好的并发处理能力,以确保在请求量激增时仍能保持良好的性能。

三、服务器性能的关键因素

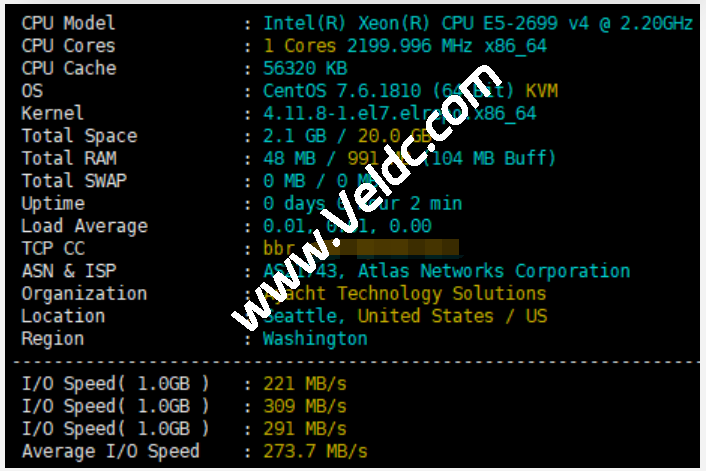

1. 硬件配置

服务器的硬件配置是影响其性能的关键因素之一。

包括CPU、内存、硬盘速度以及网络带宽等硬件资源都会对服务器处理请求的能力产生影响。

2. 软件优化

除了硬件配置,软件优化也是提高服务器性能的重要手段。

包括操作系统、Web服务器软件(如Nginx、Apache)以及应用程序本身的优化都能显著提高服务器性能。

3. 负载均衡

负载均衡技术可以在多台服务器之间分配请求,以平衡负载,提高整体性能。

在HTTP请求量较大时,负载均衡显得尤为重要。

四、优化策略

1. 提升硬件性能

提高服务器硬件性能是应对HTTP请求量增加的直接手段。

例如,增加CPU核心数、扩大内存、使用高速固态硬盘等。

2. 软件优化与升级

软件优化同样重要。

通过升级操作系统、Web服务器软件以及应用程序,可以显著提高服务器性能。

定期对软件进行优化和调试也能有效提高服务器性能。

3. 缓存策略

缓存策略可以显著减少服务器处理请求的时间。

通过缓存经常访问的数据,服务器可以在短时间内快速返回响应,提高处理速度和响应时间。

4. 负载均衡与扩展性

采用负载均衡技术可以在多台服务器之间分配请求,从而提高整体性能。

确保服务器具有良好的扩展性,以便在需要时轻松增加资源,应对更大的HTTP请求量。

五、案例分析

以某大型电商网站为例,该网站在促销活动期间遭遇了HTTP请求量激增的问题,导致网站性能下降,用户体验受损。

通过升级服务器硬件、优化软件、采用负载均衡策略以及实施缓存策略等手段,该网站成功应对了高并发请求的挑战,显著提高了性能。

六、结论

HTTP请求量与服务器性能之间密切相关。

随着HTTP请求量的增加,服务器需要更高的性能以应对挑战。

通过优化硬件配置、软件优化、实施缓存策略和负载均衡等手段,可以有效提高服务器性能,应对高并发请求的挑战。

未来,随着技术的不断发展,我们期待更加高效的服务器性能优化策略的出现,以应对更加庞大的HTTP请求量。

合并HTTP 请求是否真的有意义

不过现在能更正确更理智地去看待这些事了 3次握手由于有keep-alive,一条和一百条都只需一次tcp握手–无差别; 你的论断最大的问题是这句,事实上不是这样的 当你有100个资源时,这100个资源在浏览器看来是“同时都要”,而浏览器并没有什么智商去判断应该用1个链接解决这100个资源,还是用100个链接来解决,不然浏览器永远都只有一个tcp链接了 因此浏览器的静态的策略是在自己可承受的范围内尽可能地用多的链接来解决,大部分浏览器似乎是6-8个链接,这就导致握手也是6-8次 其他的如 @贺师俊 老师说的,网络延迟以及tcp/ip的速率协商也是很需要考虑的问题 补充说下网络延迟这东西,很多做前端的人根本不明白这一点,他们在计算传输时间的时候只会考虑到带宽这一因素,却丝毫不考虑延迟。

我就问你一个问题: 一个200m带宽、2000ms延迟的网络,和一个2m带宽,20ms延迟的网络,你喜欢哪个 实际上一个资源从客户端发出请求到客户端实际能使用的时间,排除掉dns、握手、服务器计算等,纯粹资源本身和网络相关的计算应该是: 网络延迟 * 2 + 资源大小 / 带宽 从这个公式可以看出来,当资源大小很小时,网络延迟对性能的影响会很夸张。

假设你的资源大小能在一个tcp包中传输,那你基本就看网络延迟的脸色决定网络性能了 你把100个资源不合并,就意味着要享受100倍网络延迟,而不合资的资源通常更小,导致网络延迟在每一次网络rou缉单光竿叱放癸虱含僵ndtrip里占比更重,会很痛苦的 因此,你的“只是增多了http报文头”这个推断虽然正确,但其影响远不如你想象的那么小,报头本身不大,加上gzip后更小,但是抗不住网络延迟的影响,特别是3g网络环境下会更严重 当然合并文件也是有一个限制的,这就是为啥我们在下载大文件的时候还是喜欢多线程下载,一般我肯定不会让一个资源超过1m,再大就要考虑怎么切分

如何测试web网站

1、服务器上期望的负载是多少(例如,每单位时间内的点击量),在这些负载下应该具有什么样的性能(例如,服务器反应时间,数据库查询时间)。性能测试需要什么样的测试工具呢(例如,web负载测试工具,其它已经被采用的测试工具,web 自动下载工具,等等)? 2、系统用户是谁?他们使用什么样的浏览器?使用什么类型的连接速度?他们是在公司内部(这样可能有比较快的连接速度和相似的浏览器)或者外部(这可能有使用多种浏览器和连接速度)? 3、在客户端希望有什么样的性能(例如,页面显示速度?动画、applets的速度等?如何引导和运行)? 4、允许网站维护或升级吗?投入多少? 5、需要考虑安全方面(防火墙,加密、密码等)是否需要,如何做?怎么能被测试?需要连接的Internet网站可靠性有多高?对备份系统或冗余链接请求如何处理和测试?web网站管理、升级时需要考虑哪些步骤?需求、跟踪、控制页面内容、图形、链接等有什么需求? 6、需要考虑哪种HTML规范?多么严格?允许终端用户浏览器有哪些变化? 7、页面显示和/或图片占据整个页面或页面一部分有标准或需求吗? 8、内部和外部的链接能够被验证和升级吗?多久一次? 9、产品系统上能被测试吗?或者需要一个单独的测试系统?浏览器的缓存、浏览器操作设置改变、拨号上网连接以及Internet中产生的“交通堵塞”问题在测试中是否解决,这些考虑了吗?

服务器的性能指标有哪些参数?

选购服务器时应考察的主要配置参数有哪些? CPU和内存CPU的类型、主频和数量在相当程度上决定着服务器的性能;服务器应采用专用的ECC校验内存,并且应当与不同的CPU搭配使用。

芯片组与主板即使采用相同的芯片组,不同的主板设计也会对服务器性能产生重要影响。

网卡服务器应当连接在传输速率最快的端口上,并最少配置一块千兆网卡。

对于某些有特殊应用的服务器(如FTP、文件服务器或视频点播服务器),还应当配置两块千兆网卡。

硬盘和RAID卡硬盘的读取/写入速率决定着服务器的处理速度和响应速率。

除了在入门级服务器上可采用IDE硬盘外,通常都应采用传输速率更高、扩展性更好的SCSI硬盘。

对于一些不能轻易中止运行的服务器而言,还应当采用热插拔硬盘,以保证服务器的不停机维护和扩容。

磁盘冗余采用两块或多块硬盘来实现磁盘阵列;网卡、电源、风扇等部件冗余可以保证部分硬件损坏之后,服务器仍然能够正常运行。

热插拔是指带电进行硬盘或板卡的插拔操作,实现故障恢复和系统扩容。

高防国内云服务器,国内高防物理机独立服务器就找虎跃云-www.huyuekj.com