负载均衡技术下的网站服务器需求探讨

一、引言

随着互联网技术的飞速发展,网站服务器面临着日益增长的访问压力。

为确保网站的高可用性、稳定性和扩展性,负载均衡技术成为了关键解决方案。

本文将探讨负载均衡技术在网站服务器中的应用,以及基于负载均衡技术的网站服务器需求。

二、负载均衡技术概述

负载均衡技术是一种网络优化技术,旨在将网络请求均匀分配到多个服务器资源上,以实现高效、稳定的网络服务。

负载均衡技术主要分为硬件负载均衡和软件负载均衡两大类。

1. 硬件负载均衡

硬件负载均衡器是一种专用设备,通过硬件和固件实现请求分发。

其优点在于性能较高,适用于大型网络环境。

2. 软件负载均衡

软件负载均衡则通过软件算法实现请求分发,可以部署在通用服务器上。

软件负载均衡具有灵活性和扩展性强的特点。

三、负载均衡技术在网站服务器中的应用

在网站服务器中,负载均衡技术主要应用在以下几个方面:

1. 网页访问负载均衡

当网站访问量较大时,通过负载均衡技术将访问请求均匀分配到多台服务器,提高网站的响应速度和稳定性。

2. 数据库负载均衡

数据库是网站的核心组成部分,通过负载均衡技术实现数据库查询请求的分配,提高数据库的处理能力和可扩展性。

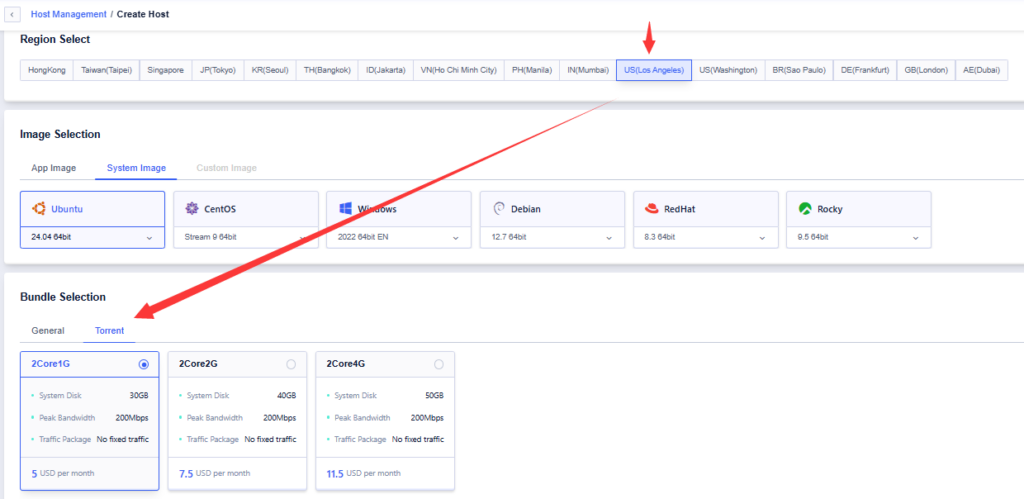

3. 云服务负载均衡

随着云计算的发展,云服务负载均衡逐渐成为主流。

通过云服务提供商的负载均衡服务,实现网站服务器的自动扩展和伸缩。

四、基于负载均衡技术的网站服务器需求

1. 服务器硬件需求

为实现负载均衡,网站服务器需要具备较高的硬件性能,包括强大的CPU、足够内存和高速网络接入。

服务器还需要支持虚拟化技术,以便实现动态资源分配。

2. 软件需求

网站服务器需要安装负载均衡软件或系统,以实现请求的分发和监控。

同时,为保证数据安全,还需要配置相应的安全软件,如防火墙、入侵检测系统等。

3. 带宽需求

随着网站访问量的增长,为满足用户的高速访问需求,网站服务器需要具备足够的带宽资源。

通过负载均衡技术,可以优化网络流量,提高带宽利用率。

4. 运维需求

基于负载均衡技术的网站服务器需要专业的运维团队进行管理和维护。

运维团队需要具备丰富的网络知识和经验,以应对可能出现的各种网络问题。

5. 扩展性需求

随着业务的不断发展,网站服务器的负载会持续增长。

因此,基于负载均衡技术的网站服务器需要具备强大的扩展性,以便在需要时能够快速扩展服务器资源。

五、总结与展望

本文探讨了负载均衡技术在网站服务器中的应用及其需求。

随着互联网的不断发展,负载均衡技术将在网站服务器中发挥越来越重要的作用。

未来,基于人工智能和大数据的负载均衡技术将成为研究热点,为网站服务器提供更高性能、更稳定的网络服务。

同时,随着边缘计算的兴起,负载均衡技术将在边缘计算领域发挥重要作用,进一步提高网站的访问速度和用户体验。

网络负载均衡的相关技术

基于特定服务器软件的负载均衡—- 这种技术是利用网络协议的重定向功能来实现负载均衡的,例如在Http协议中支持定位指令,接收到这个指令的浏览器将自动重定向到该指令指明的另一个URL上。

由于和执行服务请求相比,发送定位指令对Web服务器的负载要小得多,因此可以根据这个功能来设计一种负载均衡的服务器。

一旦Web服务器认为自己的负载较大,它就不再直接发送回浏览器请求的网页,而是送回一个定位指令,让浏览器去服务器集群中的其他服务器上获得所需要的网页。

在这种方式下,服务器本身必须支持这种功能,然而具体实现起来却有很多困难,例如一台服务器如何能保证它重定向过的服务器是比较空闲的,并且不会再次发送定位指令?定位指令和浏览器都没有这方面的支持能力,这样很容易在浏览器上形成一种死循环。

因此这种方式实际应用当中并不多见,使用这种方式实现的服务器集群软件也较少。

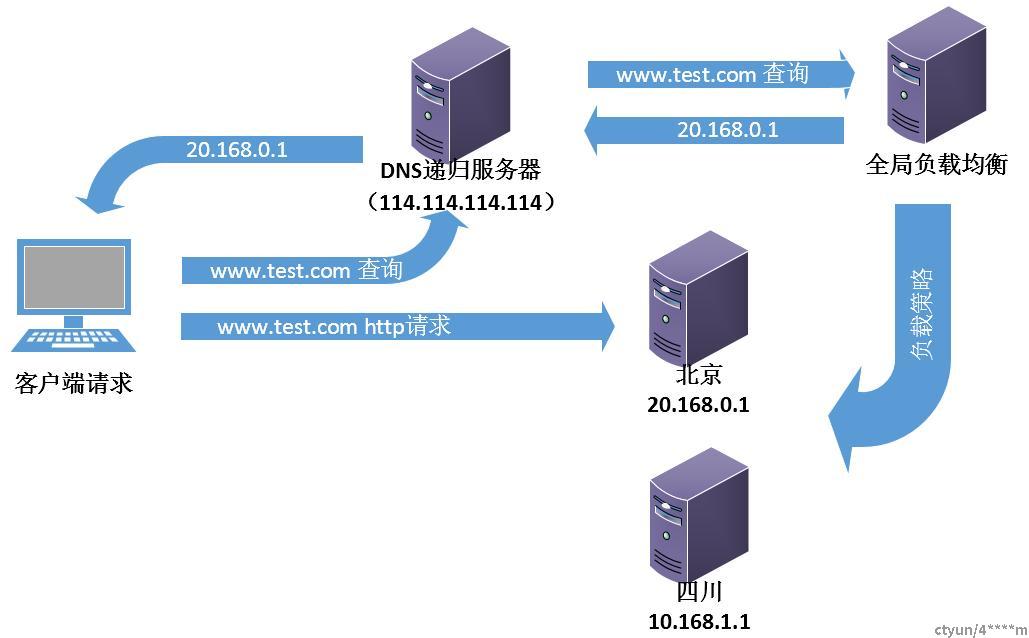

基于DNS的负载均衡—- DNS负载均衡技术是最早的负载均衡解决方案,它是通过DNS服务中的随机名字解析来实现的,在DNS服务器中,可以为多个不同的地址配置同一个名字,而最终查询这个名字的客户机将在解析这个名字时得到其中的一个地址。

因此,对于同一个名字,不同的客户机会得到不同的地址,它们也就访问不同地址上的Web服务器,从而达到负载均衡的目的。

—- 这种技术的优点是,实现简单、实施容易、成本低、适用于大多数TCP/IP应用;但是,其缺点也非常明显,首先这种方案不是真正意义上的负载均衡,DNS服务器将Http请求平均地分配到后台的Web服务器上,而不考虑每个Web服务器当前的负载情况;如果后台的Web服务器的配置和处理能力不同,最慢的Web服务器将成为系统的瓶颈,处理能力强的服务器不能充分发挥作用;其次未考虑容错,如果后台的某台Web服务器出现故障,DNS服务器仍然会把DNS请求分配到这台故障服务器上,导致不能响应客户端。

最后一点是致命的,有可能造成相当一部分客户不能享受Web服务,并且由于DNS缓存的原因,所造成的后果要持续相当长一段时间(一般DNS的刷新周期约为24小时)。

所以在国外最新的建设中心Web站点方案中,已经很少采用这种方案了。

.基于四层交换技术的负载均衡—- 这种技术是在第四层交换机上设置Web服务的虚拟IP地址,这个虚拟IP地址是DNS服务器中解析到的Web服务器的IP地址,对客户端是可见的。

当客户访问此Web应用时,客户端的Http请求会先被第四层交换机接收到,它将基于第四层交换技术实时检测后台Web服务器的负载,根据设定的算法进行快速交换。

常见的算法有轮询、加权、最少连接、随机和响应时间等。

基于七层交换技术的负载均衡—- 基于第七层交换的负载均衡技术主要用于实现Web应用的负载平衡和服务质量保证。

它与第四层交换机比较起来有许多优势:第七层交换机不仅能检查TCP/IP数据包的TCP和UDP端口号,从而转发给后台的某台服务器来处理,而且能从会话层以上来分析Http请求的URL,根据URL的不同将不同的Http请求交给不同的服务器来处理(可以具体到某一类文件,直至某一个文件),甚至同一个URL请求可以让多个服务器来响应以分担负载(当客户访问某一个URL,发起Http请求时,它实际上要与服务器建立多个会话连接,得到多个对象,例如//文档,当这些对象都下载到本地后,才组成一个完整的页面)。

—- 以上几种负载均衡技术主要应用于一个站点内的服务器群,但是由于一个站点接入Internet的带宽是有限的,因此可以把负载均衡技术开始应用于不同的网络站点之间,这就是站点镜像技术,站点镜像技术实际上利用了DNS负载均衡技术。

常见的负载均衡技术

四层负责均衡:主要是指通过判断报文的IP地址和端口并通过一定的负载均衡算法来决定转发到哪个指定目标,主要工作在OSI模型的第四层。

四层负载均衡对数据包只是起一个数据转发的作用,并不会干预客户端与服务器之间应用层的通信(如:三次握手等)。

所以能对数据所进行的操作也就很少,但相对于七层负载均衡来讲效率会高上很多 七层负载均衡:也被称为“内容交换”,指的是负载均衡设备通过报文中的应用层信息(URL、HTTP头部等信息)和负载均衡算法,选择到达目的的内部服务器。

七层负载均衡可以“智能化”地筛选报文中 应用层信息,然后根据不同的信息进行特定的负载均衡调度。

这种方式提升了应用系统在网络层上的灵活性,另外也在一定程度上提升了后端系统的安全性。

因为像网络常见的DoS攻击,这些攻击在七层负载均衡的环境下通常都在负载均衡设备上就截止了,不会影响到后台服务器的正常运行。

前网络中常见的负载均衡主要分为硬件负载均衡和软件负载均衡。

硬件负载均衡比较知名的产品有F5 Big-IP、Cirtix Netscaler等等。

而软件负载均衡就有着众多的开源项目,常见的有Haproxy、nginx、lvs等。

Haproxy: lvs: nginx: Haproxy可以做代理服务相对于nginx而言有很多相同之处,统一可以基于mode tcp进行四层代理也可以基于mode http进行七层代理,但不同的是其无法使用location和if等进行匹配判断。

突出优势在于有会话绑定,web管理界面,状态统计非常详细。

官方推荐只启用一个进程,相对于nginx多进程架构工作并不理想,更多的线程可能会受到系统内存的一些限制。

程序环境: 主程序:/usr/sbin/haproxy 主配置文件:/etc/haproxy/ Unit file:/usr/lib/systemd/system/ 查看配置文件 重要的几个参数,及性能调优,多数无需修改 发现日志发送给本机rsyslog的local2的facility,而本机的rsyslog里并没有定义,需要我们自己去配置 所以vim /etc/添加一段将local2的所有信息记录在对应日志文件中 由于HAProxy可以工作在七层模型下,因此,要实现HAProxy的强大功能,一定要使用强大灵活的ACL规则,通过ACL规则可以实现基于HAProxy的智能负载均衡系统。

HAProxy通过ACL规则完成两种主要的功能,分别是: 1)通过设置的ACL规则检查客户端请求是否合法。

如果符合ACL规则要求,那么将放行;如果不符合规则,则直接中断请求。

2)符合ACL规则要求的请求将被提交到后端的backend服务器集群,进而实现基于ACL规则的负载均衡。

HAProxy中的ACL规则经常使用在frontend段中,使用方法如下: acl 自定义的acl 名称 acl 方法 -i [ 匹配的路径或文件] 其中: ·acl:是一个关键字,表示定义ACL规则的开始。

后面需要跟上自定义的ACL名称。

·acl方法:这个字段用来定义实现ACL的方法,HAProxy定义了很多ACL方法,经常使用的方法有hdr_reg(host)、hdr_dom(host)、hdr_beg(host)、url_sub、url_dir、path_beg、path_end等。

·-i:表示不区分大小写,后面需要跟上匹配的路径或文件或正则表达式。

与ACL规则一起使用的HAProxy参数还有use_backend,use_backend后面需要跟上一个backend实例名,表示在满足ACL规则后去请求哪个backend实例,与use_backend对应的还有default_backend参数,它表示在没有满足ACL条件的时候默认使用哪个后端 这些例子定义了www_policy、bbs_policy、url_policy三个ACL规则,第一条规则表示如果客户端以 或 开头的域名发送请求时,则此规则返回true,同理第二条规则表示如果客户端通过 域名发送请求时,则此规则返回true,而第三条规则表示如果客户端在请求的URL中包含“buy_sid=”字符串时,则此规则返回true。

第四、第五、第六条规则定义了当www_policy、bbs_policy、url_policy三个ACL规则返回true时要调度到哪个后端backend,例如,当用户的请求满足www_policy规则时,那么HAProxy会将用户的请求直接发往名为server_www的后端backend,其他以此类推。

而当用户的请求不满足任何一个ACL规则时,HAProxy就会把请求发往由default_backend选项指定的server_cache这个后端backend。

与上面的例子类似,本例中也定义了url_static、host_www和host_static三个ACL规则,其中,第一条规则通过path_end参数定义了如果客户端在请求的URL中以、、、或结尾时返回true,第二条规则通过hdr_beg(host)参数定义了如果客户端以www开头的域名发送请求时则返回true,同理,第三条规则也是通过hdr_beg(host)参数定义了如果客户端以img.、video.、download.或ftp.开头的域名发送请求时则返回true。

第四、第五条规则定义了当满足ACL规则后要调度到哪个后端backend,例如,当用户的请求同时满足host_static规则与url_static规则,或同时满足host_www和url_static规则时,那么会将用户请求直接发往名为static的后端backend,如果用户请求满足host_www规则,那么请求将被调度到名为www的后端backend,如果不满足所有规则,那么将用户请求默认调度到名为server_cache的这个后端backend。

log:全局的日志配置,local0是日志设备,info表示日志级别。

其中日志级别有err、warning、info、debug4种可选。

这个配置表示使用127.0.0.1上的rsyslog服务中的local0日志设备,记录日志等级为info。

maxconn:设定每个HAProxy进程可接受的最大并发连接数,此选项等同于Linux命令行选项“ulimit -n”。

user/group:设置运行HAProxy进程的用户和组,也可使用用户和组的uid和gid值来替代。

daemon:设置HAProxy进程进入后台运行。

这是推荐的运行模式。

nbproc:设置HAProxy启动时可创建的进程数,此参数要求将HAProxy运行模式设置为daemon,默认只启动一个进程。

该值的设置应该小于服务器的CPU核数。

创建多个进程,能够减少每个进程的任务队列,但是过多的进程可能会导致进程崩溃。

pidfile:指定HAProxy进程的pid文件。

启动进程的用户必须有访问此文件的权限。

mode:设置HAProxy实例默认的运行模式,有tcp、http、health三个可选值。

retries:设置连接后端服务器的失败重试次数,如果连接失败的次数超过这里设置的值,HAProxy会将对应的后端服务器标记为不可用。

此参数也可在后面部分进行设置。

timeout connect:设置成功连接到一台服务器的最长等待时间,默认单位是毫秒,但也可以使用其他的时间单位后缀。

timeout client:设置连接客户端发送数据时最长等待时间,默认单位是毫秒,也可以使用其他的时间单位后缀。

timeout server:设置服务器端回应客户端数据发送的最长等待时间,默认单位是毫秒,也可以使用其他的时间单位后缀。

timeout check:设置对后端服务器的检测超时时间,默认单位是毫秒,也可以使用其他的时间单位后缀。

bind:此选项只能在frontend和listen部分进行定义,用于定义一个或几个监听的套接字。

bind的使用格式为: bind [<address>:<port_range>] interface <interface>其可以为主机名或IP地址,如果将其设置为“*”或“0.0.0.0”,将监听当前系统的所有IPv4地址。

port_range可以是一个特定的TCP端口,也可是一个端口范围,小于1024的端口需要有特定权限的用户才能使用。

interface为可选选项,用来指定网络接口的名称,只能在Linux系统上使用。

option httplog:在默认情况下,HAProxy日志是不记录HTTP请求的,这样很不方便HAProxy问题的排查与监控。

通过此选项可以启用日志记录HTTP请求。

option forwardfor:如果后端服务器需要获得客户端的真实IP,就需要配置此参数。

由于HAProxy工作于反向代理模式,因此发往后端真实服务器的请求中的客户端IP均为HAProxy主机的IP,而非真正访问客户端的地址,这就导致真实服务器端无法记录客户端真正请求来源的IP,而X-Forwarded-For则可用于解决此问题。

通过使用forwardfor选项,HAProxy就可以向每个发往后端真实服务器的请求添加X-Forwarded-For记录,这样后端真实服务器日志可以通过“X-Forwarded-For”信息来记录客户端来源IP。

option httpclose:此选项表示在客户端和服务器端完成一次连接请求后,HAProxy将主动关闭此TCP连接。

这是对性能非常有帮助的一个参数。

log global:表示使用全局的日志配置,这里的global表示引用在HAProxy配置文件global部分中定义的log选项配置格式。

default_backend:指定默认的后端服务器池,也就是指定一组后端真实服务器,而这些真实服务器组将在backend段进行定义。

这里的htmpool就是一个后端服务器组。

option redispatch:此参数用于cookie保持的环境中。

在默认情况下,HAProxy会将其请求的后端服务器的serverID插入cookie中,以保证会话的session持久性。

而如果后端的服务器出现故障,客户端的cookie是不会刷新的,这就会出现问题。

此时,如果设置此参数,就会将客户的请求强制定向到另外一台健康的后端服务器上,以保证服务正常。

option abortonclose:如果设置了此参数,可以在服务器负载很高的情况下,自动结束当前队列中处理时间比较长的连接。

-balance:此关键字用来定义负载均衡算法。

目前HAProxy支持多种负载均衡算法,常用的有如下几种: cookie:表示允许向cookie插入SERVERID,每台服务器的SERVERID可在下面的server关键字中使用cookie关键字定义。

option httpchk:此选项表示启用HTTP的服务状态检测功能。

HAProxy作为一个专业的负载均衡器,它支持对backend部分指定的后端服务节点的健康检查,以保证在后端backend中某个节点不能服务时,把从frotend端进来的客户端请求分配至backend中其他健康节点上,从而保证整体服务的可用性。

option httpchk的用法如下: option httpchk <method> <uri> <version> 其中,各个参数的含义如下: check:表示启用对此后端服务器执行健康状态检查。

inter:设置健康状态检查的时间间隔,单位为毫秒。

rise:设置从故障状态转换至正常状态需要成功检查的次数,例如,“rise 2”表示2次检查正确就认为此服务器可用。

fall:设置后端服务器从正常状态转换为不可用状态需要检查的次数,例如,“fall 3”表示3次检查失败就认为此服务器不可用。

cookie:为指定的后端服务器设定cookie值,此处指定的值将在请求入站时被检查,第一次为此值挑选的后端服务器将在后续的请求中一直被选中,其目的在于实现持久连接的功能。

上面的“cookie server1”表示web1的serverid为server1。

同理,“cookie server2”表示web2的serverid为server2。

weight:设置后端真实服务器的权重,默认为1,最大值为256。

设置为0表示不参与负载均衡。

backup:设置后端真实服务器的备份服务器,仅仅在后端所有真实服务器均不可用的情况下才启用。

用nginx反代后端的两台tomcat主机,做动静分离,如果是jsp结尾的就发往后端,否则就交给nginx处理。

在两台tomcat主机上创建应用 nginx配置 则动静分离就实现了,并且我们还基于uri实现了会话粘性

面试官:什么是负载均衡?常见的负载均衡策略有哪些?

本文学习目标:负载均衡一、负载均衡负载均衡是云计算的关键组件,是网络流量的入口,其重要性显而易见。

负载均衡通过负载均衡器,将用户请求或流量均匀分布到后端的多个服务器,实现流量分担,达到横向扩展(scale out)的目的,同时提升系统的高可用性。

二、负载均衡模型分类负载均衡模型主要分为全局负载均衡和集群内负载均衡。

全局负载均衡通常通过DNS实现,通过解析域名到不同VIP,实现不同区域的流量调度。

硬件负载均衡器如F5、A10、Array,具备强大功能和专业的售后服务团队,但灵活性受限,维护成本较高。

现今更多采用软件负载均衡,如LVS、Nginx、Haproxy,以满足各种定制需求。

三、CDN负载均衡四、LVS负载均衡四、LVS支持的三种模式早期LVS支持三种模式:DR、TUN、NAT。

其中,DR模式通过LVS更改MAC地址,封装MAC头,内部IP报文保持不变,适用于二层网络部署,但在大规模集群部署中灵活性受限。

TUN模式在原有报文基础上封装IP头,后端服务器需要解开IP报文封装,获取原始报文。

NAT模式用户访问VIP,LVS进行DNAT转换后选择服务器,客户端IP保持不变,后端服务器直接将响应包返回给用户。

五、负载均衡策略负载均衡的核心是策略,由算法或逻辑支撑。

常见的策略包括轮询、加权轮询、最少连接数、最快响应和Hash法。

每种策略都有其优点和适用场景,如轮询简单平均分配;加权轮询根据服务器性能差异分配权重;最少连接数根据实时负载动态分配;最快响应根据响应时间动态分配;Hash法根据客户端标识均匀分配。

六、负载均衡策略图解本文详细解释了轮询、加权轮询、最少连接数、最快响应和Hash法的实现原理和优缺点。

轮询简单平均分配,加权轮询根据权重分配请求;最少连接数动态分配,最快响应根据响应时间分配;Hash法则根据客户端标识均匀分配请求。

七、健康探测保障高可用为了确保负载均衡系统的高可用性,需要结合健康探测机制。

定期检查服务端是否可连接,响应是否及时。

如果检测到节点故障,则暂时将其移出选取列表,提高系统可用性。

常用的健康探测方式包括HTTP探测、TCP探测和UDP探测,分别基于HTTP状态码、TCP三次握手和UDP报文进行判断。