揭秘服务器支持并发数的极限——以一台服务器为例

随着互联网的普及和数字化进程的加速,服务器已成为企业、组织乃至个人不可或缺的重要设备。

其中,服务器的并发处理能力是衡量其性能的重要指标之一。

那么,一台服务器的并发数极限究竟是多少?本文将就此话题展开讨论,并带您小哥了解服务器并发数的奥秘。

一、服务器并发数的概念

并发数,指的是服务器在同一时间内处理多个请求的能力。

在实际应用中,服务器需要处理来自众多客户端的请求,如网页访问、文件下载、数据库操作等。

服务器的并发处理能力直接影响到其响应速度和性能。

因此,了解服务器的并发数极限,对于合理部署和优化服务器资源具有重要意义。

二、服务器并发数的决定因素

服务器并发数的极限受多种因素影响,主要包括以下几个方面:

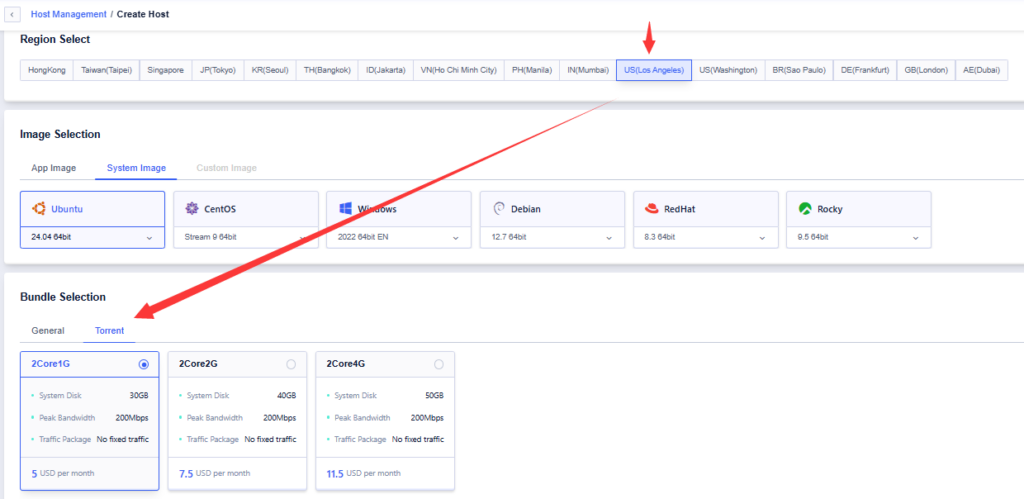

1. 服务器硬件配置:包括CPU、内存、硬盘、网络带宽等。高性能的硬件配置能支持更多的并发请求。

2. 操作系统和软件架构:不同的操作系统和软件架构对并发处理有不同的性能表现。

3. 应用类型和负载:不同类型的应用和负载对服务器并发处理能力的要求不同。

4. 负载均衡与扩展性:通过负载均衡技术和扩展性设计,可有效提高服务器的并发处理能力。

三、服务器并发数的极限

服务器并发数的极限是一个复杂的问题,难以给出具体的数值。

因为实际表现会受到诸多因素的影响,如硬件性能、软件优化、网络状况等。

我们可以通过一些测试和案例分析,来揭示服务器并发数的部分奥秘。

以一台高性能的服务器为例,经过优化配置和负载均衡,其并发数可以达到数千甚至数万。

但这并不意味着服务器的并发数可以无限增长。

随着并发数的增加,服务器的响应速度和性能会逐渐下降,直至无法承受更多的请求。

因此,合理评估服务器的并发能力,对于保障系统的稳定性和性能至关重要。

四、如何提高服务器并发处理能力

为了提高服务器的并发处理能力,可以采取以下措施:

1. 升级硬件配置:提高CPU性能、增加内存、优化硬盘和网络带宽等。

2. 选择合适的操作系统和软件架构:根据应用需求和负载特点,选择性能优越的操作系统和软件架构。

3. 负载均衡:通过负载均衡技术,将请求分散到多台服务器上,以提高整体并发处理能力。

4. 扩展性设计:采用微服务、容器化等技术,实现系统的水平扩展和垂直扩展。

5. 监控与优化:定期监控服务器性能,发现并解决瓶颈问题,优化系统性能。

五、案例分析

以某大型电商网站为例,该网站在高峰期需要处理大量用户请求。为了提高并发处理能力,采取了以下措施:

1. 升级服务器硬件和部署更多服务器。

2. 采用负载均衡技术,将请求分散到多台服务器上。

3. 优化软件架构,提高系统的响应速度和并发处理能力。

4. 实施缓存策略,减少数据库访问压力。

5. 定期进行性能监控和优化。

通过以上措施,该电商网站的并发处理能力得到了显著提升,成功应对了高峰期的用户请求。

六、总结

服务器支持并发数的极限是一个复杂的问题,受到多种因素的影响。

通过合理的硬件配置、软件优化、负载均衡和扩展性设计等措施,可以有效提高服务器的并发处理能力。

在实际应用中,还需要根据具体情况进行监控和优化,以保障系统的稳定性和性能。

希望本文能为您揭示服务器并发数的奥秘,助您更好地了解和优化服务器资源。

高防国内云服务器,国内高防物理机独立服务器就找虎跃云-www.huyuekj.com